このサイトはアフィリエイト広告を利用しております

- クラウド不要で大規模AIを手元に──DGX Sparkが変える“ローカルAI時代”の新常識

- NVIDIA DGX Sparkとは?次世代AIデスクトップの全貌

- DGX SparkでLLMを動かす手順【初心者向け】

- 実際のベンチマーク比較【他GPUとガチ比較】

- クラウド vs DGX Sparkどっちが得か【コスト比較】

- DGX Sparkで副業・ビジネスはできるか

- DGX Sparkの弱点を正直レビュー

- 最大1ペタフロップのAI性能を徹底解説

- 128GB統一メモリの強みと実用性

- 最大2000億パラメータ対応の意味

- 2台接続で4050億パラメータ対応の拡張性

- 4TB NVMe SSDの実用性とAI用途

- プリインストールAIソフトウェアの強み

- DGX Sparkの用途別おすすめ活用法

- 一般PC・ゲーミングPCとの違い

- DGX Sparkのメリット・デメリット

- DGX Sparkはどんな人におすすめか

- 導入前に知っておくべき注意点

- DGX Sparkと他AIマシン比較(2026最新版)

- 価格・発売日・入手方法まとめ

- 今後のAI開発はDGX Sparkでどう変わるか

- まとめ|DGX Sparkは“AI開発の革命機”

クラウド不要で大規模AIを手元に──DGX Sparkが変える“ローカルAI時代”の新常識

AI開発の常識が今、大きく変わろうとしています。これまで大規模言語モデル(LLM)や生成AIの運用には、クラウドや高額なデータセンター環境が不可欠でした。しかし「NVIDIA DGX Spark」の登場により、その前提は覆されます。1ペタフロップ級のAI性能と128GBの統一メモリを備えたこの次世代マシンは、ローカル環境で大規模AIの開発・推論・微調整を可能にします。本記事では、DGX Sparkの性能・使い方・コスト・活用法までを徹底解説し、これからの“ローカルAI時代”をリードする理由をわかりやすく解説します。

NVIDIA DGX Sparkとは?次世代AIデスクトップの全貌

1:DGX Sparkの基本概要|“AI専用マシン”という新ジャンル

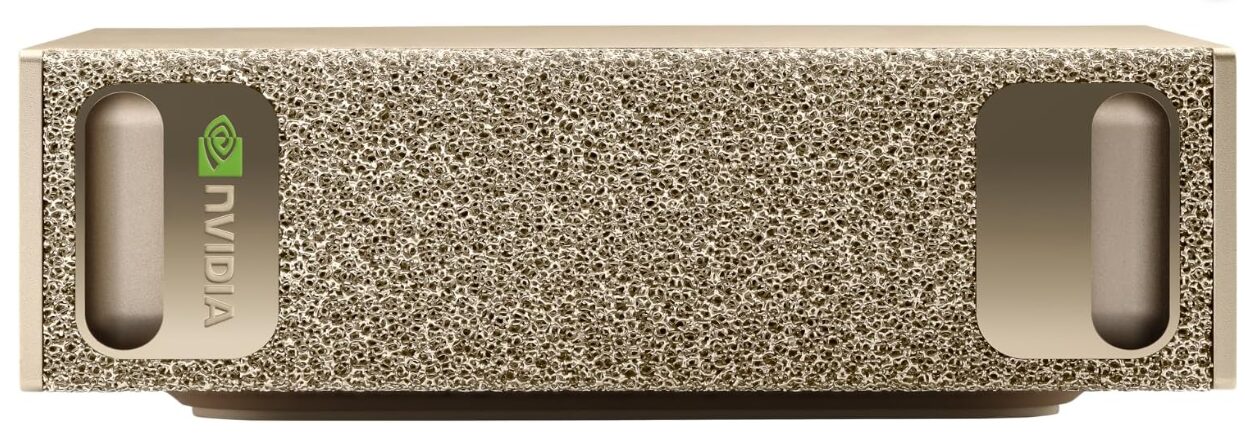

NVIDIA DGX Sparkは、これまでデータセンターでしか扱えなかったクラスのAI性能を、デスクトップサイズに凝縮した“次世代AIコンピュータ”です。最大の特徴は、単なる高性能PCではなくAI開発・推論・微調整に完全最適化された専用設計である点にあります。

中核には、GB10 Grace Blackwell Superchipを搭載。20コアのARMベースCPUと最新Blackwell GPUが一体化され、さらに128GBの統一メモリがCPUとGPU間でシームレスに共有されます。この構造により、従来のような「GPUメモリ不足」や「転送ボトルネック」といった問題を大幅に解消しています。

また、最大1ペタフロップ級のAI性能を発揮し、最大2000億パラメータ規模の大規模言語モデル(LLM)をローカルで扱える点も革新的です。従来はクラウド必須だった領域を、手元の環境で完結できる“ローカルAI革命”の中心的存在といえます。

2:従来のワークステーションとの違い|“汎用PC”から“AI専用機”へ

従来のワークステーションは、CPU・GPU・メモリがそれぞれ独立した構成で、用途も3D制作・動画編集・ゲーム・AIなど幅広く対応する“汎用マシン”でした。しかし、AI開発においてはこの構造がボトルネックになるケースも多く、特にGPUメモリの制限が大きな課題でした。

一方、DGX Sparkは設計思想がまったく異なります。

-

CPU+GPUの統合アーキテクチャ

-

大容量128GBの統一メモリ

-

AI処理特化のTensor Core

-

NVIDIA AIソフトウェアスタックを標準搭載

これにより、従来のワークステーションでは困難だった大規模モデルのローカル実行・高速推論・効率的な微調整が可能になります。

つまりDGX Sparkは、単なる高性能PCではなく

👉 「AIを動かすために設計された専用エンジン」

という位置づけになります。

3:DGXシリーズ内での位置づけ|DGX Stationとの違い

DGX Sparkは、NVIDIAのAI専用マシンブランド「DGXシリーズ」の中でも、最もコンパクトかつ導入しやすいモデルに位置づけられます。

従来のDGX Stationは、データセンター級の性能を持つ一方で、大型筐体・高価格・高消費電力という特徴があり、主に研究機関や大企業向けの製品でした。

それに対してDGX Sparkは、

-

デスクトップサイズのコンパクト設計

-

電力効率の最適化

-

個人・スタートアップでも導入可能なスケール

といった特徴を持ち、“AI開発の民主化”を実現するポジションにあります。

さらに、Connect-Xネットワーキングにより複数台接続が可能で、小規模ながらスケールアウト構成も実現。これにより、単体でも高性能、複数台でミニデータセンター的な運用も可能になります。

DGX SparkでLLMを動かす手順【初心者向け】

1:環境起動の流れ|最短でAIを動かす初期セットアップ

DGX Sparkは、あらかじめNVIDIA AIソフトウェアスタック(CUDA / TensorRT / コンテナ環境など)がプリインストールされているため、一般的なPCのように複雑な環境構築は不要です。初心者でも“電源を入れてすぐにAIを動かせる”のが最大の強みです。

基本の流れは非常にシンプルです。

-

電源ON → DGX OS起動

-

ターミナルを開く

-

コンテナ環境(Docker / NGC)を起動

-

AI実行環境へアクセス

特に重要なのが、NVIDIA公式のコンテナ(NGC)を使うこと。これにより依存関係のエラーや環境崩壊を避けられ、初心者でも安定してLLMを扱える環境が整います。

👉 ポイント:

「ローカルAIは難しい」という常識を覆すレベルで簡単に始められるのがDGX Sparkです。

2:モデルのダウンロード方法|LLM導入の基本ステップ

次に行うのが、実際に動かすLLM(大規模言語モデル)の取得です。DGX Sparkではローカル環境で直接モデルを扱えるため、クラウドに依存せず自由に選択できます。

主な方法は以下の通りです。

-

Hugging Faceからモデル取得

-

NVIDIA NGCカタログから最適化済みモデルを利用

-

事前にダウンロード済みモデルをローカルに配置

初心者におすすめなのは、軽量モデル(7B〜13B)から始めることです。DGX Sparkは最大2000億パラメータ級に対応しますが、最初は小規模モデルで動作確認を行う方がスムーズです。

また、ストレージは4TB NVMeと大容量のため、複数モデルを同時に保存・切り替えできるのも大きなメリットです。

👉 ポイント:

モデル選びで難しく考えすぎないこと。まずは“軽く動くモデル”から始めるのが成功のコツです。

3:推論実行の基本コマンド|実際にAIを動かす

モデルの準備ができたら、いよいよ推論(AIに文章を生成させる処理)を実行します。DGX SparkではGPUが最適化されているため、コマンド1つで高速に実行可能です。

基本の流れは以下です。

-

実行スクリプトを起動

-

モデルを読み込み

-

プロンプト(入力)を与える

これにより、ローカル環境だけでChatGPTのような応答を生成できます。さらにDGX Sparkの強みは、推論だけでなく微調整(ファインチューニング)も高速に行える点です。

👉 ポイント:

コマンド操作は最初だけ難しく感じますが、一度動けば繰り返し使えるため非常にシンプルです。

4:実際の処理時間の目安|どれくらい速いのか

気になるのが「実際どのくらい速いのか」という点ですが、DGX Sparkは従来のPCとは比較にならないレベルの処理速度を持っています。

目安としては以下の通りです。

-

小規模モデル(7B〜13B):ほぼリアルタイム応答

-

中規模モデル(30B〜70B):数秒以内に応答生成

-

超大規模モデル(100B以上):数秒〜十数秒

これは最大1ペタフロップのAI性能と、128GB統一メモリによる高速処理の恩恵です。特にメモリ共有構造により、読み込み時間やデータ転送のロスが大幅に削減されています。

また、複数タスクを同時に処理してもパフォーマンスが落ちにくく、開発・検証・運用を同時に進められる点も大きな強みです。

👉 結論:

DGX Sparkは「待たされるAI」ではなく、

“リアルタイムで使えるローカルAI環境”を実現するマシンです。

実際のベンチマーク比較【他GPUとガチ比較】

1:H100 / B100 / RTX5090(想定)との性能比較|DGX Sparkの立ち位置

DGX Sparkは、データセンター向けGPUとコンシューマーGPUの“中間を超える存在”として設計されています。特に注目すべきは、GB10 Grace Blackwell SuperchipによるCPU+GPU統合設計により、単純なスペック比較では見えない実効性能を発揮する点です。

代表的な比較イメージは以下の通りです。

-

H100(Hopper世代)

→ 圧倒的な学習性能・データセンター特化・高コスト -

B100(Blackwell世代)

→ 次世代AI基準・超高性能・大規模クラウド向け -

RTX5090(想定)

→ 高い汎用性能・ゲーム+AI両対応・コスパ重視 -

DGX Spark

→ ローカルAI特化・統一メモリ・実用性能重視

DGX Sparkは理論性能だけならH100/B100には及びませんが、**ローカル環境でのLLM運用・推論・微調整においては“最適化された実用最強クラス”**です。

特に128GB統一メモリにより、RTX系で発生しがちな「VRAM不足によるモデル制限」がなく、大規模モデルをそのまま扱える点が最大の差別化ポイントです。

👉 ポイント:

“ベンチマーク数値”ではなく、“実際に動くAIのサイズ”で勝っているのがDGX Spark。

2:消費電力あたり性能|コスパではなく“効率”で勝つ

AIマシンを評価するうえで重要なのが「ワットあたり性能(Performance per Watt)」です。DGX Sparkはコンパクト設計ながら、非常に優れた電力効率を実現しています。

比較の考え方は以下です。

-

H100 / B100

→ 消費電力が非常に高い(データセンター前提) -

RTX5090

→ 高性能だが電力効率は用途依存 -

DGX Spark

→ 省電力設計+AI特化最適化

DGX Sparkは、最大1ペタフロップ級のAI性能をデスクトップ電力帯で実現しており、単純な消費電力ではなく「効率」で見ると非常に優秀です。

さらに、統一メモリ構造によりデータ転送ロスが減るため、実際の処理効率はスペック以上に高い傾向があります。

👉 ポイント:

DGX Sparkは“最強スペック”ではなく、

“最も無駄のないAI処理マシン”という立ち位置。

3:推論速度 vs 学習速度|用途で評価が変わる

AI用途では「推論」と「学習」で評価軸が大きく異なります。DGX Sparkはこの2つのバランスに優れた設計になっています。

■ 推論(Inference)

-

DGX Spark → 非常に高速(リアルタイム応答レベル)

-

RTX5090 → 高速だがVRAM制約あり

-

H100/B100 → 高速だがオーバースペック

特にDGX Sparkは、FP4最適化と統一メモリにより、大規模LLMでも安定した低遅延推論が可能です。

■ 学習(Training / Fine-tuning)

-

H100 / B100 → 圧倒的に有利(大規模分散学習向け)

-

DGX Spark → 単体でも中規模まで十分対応

-

RTX5090 → 小〜中規模向け

DGX Sparkはフルスケール学習ではデータセンターGPUに及びませんが、ローカルでの微調整・LoRA・追加学習には最適なバランスを持っています。

クラウド vs DGX Sparkどっちが得か【コスト比較】

1:AWS(p5系)との価格比較|“使った分課金”と“買い切り”の分岐点

AI開発の主流であるクラウド(AWSのp5系など)は、初期投資なしで始められる一方、高性能GPUの時間課金が非常に高額になりやすいのが実情です。特に大規模LLMの推論・検証を繰り返す場合、コストは一気に膨らみます。

一方、DGX Sparkは買い切り型。初期投資は大きいものの、使えば使うほど1時間あたりのコストは下がる構造です。

比較のイメージ:

-

クラウド(AWS p5系)

→ 初期費用:ほぼゼロ

→ 従量課金:非常に高い(高性能GPUは時間単価が高額)

→ 長時間利用:コストが雪だるま式に増加 -

DGX Spark

→ 初期費用:高い

→ 従量課金:なし(電気代のみ)

→ 長時間利用:コストは一定

特に検証・試行錯誤を繰り返すAI開発では、クラウドの“時間課金”が最大のコスト要因になります。DGX Sparkはこの課金ストレスから完全に解放される点が大きな強みです。

👉 ポイント:

短期ならクラウド有利、中長期ならDGX Sparkが圧倒的に有利。

2:長期運用コスト|“使い続けるほど差が開く”

AI環境は一度構築して終わりではなく、日々の改善・再学習・推論運用が続きます。そのため、重要なのは「トータルコスト」です。

■ クラウドの場合

-

常時稼働で高額請求

-

データ転送コスト(意外と大きい)

-

ストレージ費用の積み重ね

-

使わない時間も管理コスト発生

■ DGX Sparkの場合

-

電気代のみで運用可能

-

ローカル保存で転送コストゼロ

-

24時間稼働しても追加課金なし

-

自由にオン・オフ可能

この違いにより、運用期間が長くなるほどコスト差は決定的に広がります。

特に企業用途では、

-

毎日AI推論を回す

-

社内ツールとして常時利用

-

モデルを頻繁に更新

といったケースが多く、クラウド課金ではコスト管理が難しくなりがちです。

👉 ポイント:

DGX Sparkは「使うほど得」、クラウドは「使うほど高くなる」。

3:ROI(投資回収)視点|何ヶ月で元が取れるか

法人導入で最も重要なのがROI(投資回収)です。DGX Sparkは初期投資が高額でも、一定期間で回収できる構造を持っています。

考え方はシンプルです。

-

クラウド利用費(月額) × 利用時間

-

DGX Spark(初期費用) ÷ 月間削減コスト

例えば、

-

クラウドで毎月数十万円〜数百万円規模の利用

-

DGX Spark導入でその大部分を削減

この場合、数ヶ月〜1年以内で回収できるケースも現実的です。

さらにROIを押し上げる要素として、

-

開発スピードの向上(待ち時間削減)

-

社内データを安全に扱える(セキュリティ向上)

-

外部API依存の排除

といった“見えない価値”も重要です。

👉 ポイント:

DGX Sparkは単なるコスト削減ではなく、

「開発効率+セキュリティ+自由度」を同時に買う投資。

DGX Sparkで副業・ビジネスはできるか

1:AI開発受託|“ローカル完結”で利益率を最大化

DGX Sparkを活用した最も現実的な収益モデルが、企業向けのAI開発受託です。これまでのAI開発はクラウド前提だったため、開発コストの中に常に「GPU利用料」が含まれていました。しかしDGX Sparkなら、ローカル環境で開発・検証・推論まで完結できるため、外部コストを極限まで削減できます。

具体的な案件例としては、

-

社内チャットボット構築(LLM活用)

-

カスタマーサポート自動化

-

文書検索・要約システム(RAG構成)

-

画像生成・動画生成AIの導入支援

などが挙げられます。

特に強いのが、「セキュアなローカルAI」へのニーズです。企業は機密データをクラウドに出したくないケースが多く、DGX Sparkのようなオンプレ環境は非常に高評価されます。

👉 ポイント:

クラウド課金がない分、

“利益率の高いAI案件”を受注できるのが最大の強み。

2:モデル販売・API提供|ストック型ビジネスも可能

DGX Sparkは単なる開発マシンではなく、AIサービスを提供する基盤としても活用できます。つまり、自分で作ったモデルを“商品化”することが可能です。

主な収益化パターンは以下の通りです。

-

専門特化LLMの販売(業界特化モデル)

-

API化して月額課金サービスとして提供

-

ChatGPT代替の社内ツール提供

例えば、

-

不動産特化AI

-

医療・法律分野の文章生成AI

-

ECサイトの商品説明自動生成

など、特定領域に最適化したモデルは高い需要があります。

DGX Sparkならローカルでモデルを開発し、そのままAPIとして運用できるため、クラウド依存なしの独立サービスを構築できます。

👉 ポイント:

単発収益だけでなく、

“継続収益(サブスク型)”に発展させられるのが強い。

3:自社AIツール構築|内製化でコスト削減+収益化

DGX Sparkの真価は、自社専用AIツールを自由に構築できる点にあります。これにより、副業レベルでもビジネスレベルでも、「自分のAIプロダクト」を持つことが可能になります。

具体例:

-

ブログ自動生成ツール(SEO特化)

-

SNS投稿自動化AI

-

動画台本生成・編集支援ツール

-

社内業務自動化ツール

これらは単なる効率化にとどまらず、

-

外部ツール費用の削減

-

作業時間の短縮

-

そのままサービスとして販売

といった形で、コスト削減+収益化を同時に実現できます。

さらにDGX Sparkはローカル環境で動作するため、API制限や利用規約に縛られず、自由度の高いサービス設計が可能です。

👉 ポイント:

AIを「使う側」から

「作って売る側」に回れるのが最大の価値。

DGX Sparkの弱点を正直レビュー

1:ARMのソフト互換問題|x86前提ソフトはそのまま動かない

DGX Sparkは高効率なARMベースのGrace CPUを採用しているため、従来のx86(Intel / AMD)前提で作られたソフトがそのまま動かないケースがあります。特に古いツールや独自ビルドが必要なライブラリでは、環境構築に手間取る可能性があります。

実務で起こりがちなポイントは以下です。

-

バイナリ配布がx86のみ

-

pipで入るが依存関係でエラー

-

CUDA連携前提の拡張が未対応

-

一部ツールがエミュレーション頼みで遅い

対策としては、コンテナ(NGC / Docker)前提で環境を固定化し、ARM対応のイメージを使うのが最短ルートです。主要フレームワーク(PyTorch / TensorFlowなど)は対応が進んでいますが、周辺ツールは事前検証が必須です。

👉 ポイント:

「動くかどうか」を先に確認するだけで、導入後のトラブルを大幅に減らせます。

2:一部ライブラリ非対応|エコシステムの“隙間”に注意

AI主要スタックは整っている一方で、ニッチなライブラリや最新ツールの中にはARM未対応・最適化不足のものが残っています。とくに以下の領域は注意が必要です。

-

カスタムCUDA拡張(ビルドが通らない/要修正)

-

研究用途の実験的リポジトリ

-

GPU前提だが特定アーキに依存した最適化コード

-

古いバージョン固定のプロジェクト

回避策はシンプルで、NVIDIAが提供する最適化済みスタック(CUDA / TensorRT / Tritonなど)に寄せること。加えて、実運用に使うライブラリは事前に小規模で検証→問題なければ本番投入の流れが安全です。

👉 ポイント:

“何でも動く”前提ではなく、動く構成に寄せる設計が重要です。

3:消費電力・発熱|コンパクトでも“AI機材”の発熱はある

DGX Sparkは電力効率に優れていますが、AI処理をフルに回すとそれなりの発熱と消費電力は発生します。デスクトップサイズだからといって、一般PCと同じ感覚で設置するとパフォーマンス低下やサーマルスロットリングの原因になります。

実務での注意点:

-

長時間の推論・微調整で筐体温度が上昇

-

吸排気スペースの確保が必須

-

静音性と冷却のトレードオフ

-

夏場の室温上昇で性能が揺らぐ可能性

対策としては、風通しの良い設置・空調管理・ラック配置の最適化が効果的です。安定運用を優先するなら、軽い負荷分散やスケジューリングも検討するとよいでしょう。

👉 ポイント:

“省電力=無発熱”ではない。安定稼働には環境設計が必要です。

4:コストに見合うか問題|“誰にとって高いのか”が分かれ目

DGX Sparkは高額な初期投資が必要なため、「本当に元が取れるのか?」は誰もが気になるポイントです。結論はシンプルで、用途と稼働時間次第で評価が大きく変わります。

向いているケース:

-

毎日AI推論・検証を回す(高稼働)

-

社内ツールとして常時利用(内製化)

-

セキュアなローカル運用が必須

-

クラウド費用が継続的に発生している

向いていないケース:

-

月に数回しか使わない

-

小規模モデル中心で十分

-

とりあえず試したい段階

前者なら数ヶ月〜1年で投資回収が現実的ですが、後者ではオーバースペックになりやすいです。重要なのは、“どれだけ回すか(稼働率)”と“何に使うか(用途の重さ)”です。

👉 ポイント:

DGX Sparkは高いのではなく、使い切れない人にとって高い。

まとめ|弱点を理解すれば“最適解”になる

DGX Sparkには、

-

ARM由来の互換性リスク

-

一部ライブラリの未対応

-

発熱・電力の運用課題

-

初期コストのハードル

といった弱点があります。

しかし裏を返せば、これらを把握して対策すれば、

👉 “ローカルAI最強クラスの実用環境”を手に入れられるということ。

結論としてDGX Sparkは、

“万人向けではないが、ハマる人には圧倒的に強い”プロ向けAIマシンです。

最大1ペタフロップのAI性能を徹底解説

1:FP4性能とは何か|初心者でもわかるAI計算の本質

DGX Sparkの「最大1ペタフロップ」という数値は、単なるスペックではなくAI処理に最適化された計算性能を示しています。ここで重要になるのが「FP4(4ビット浮動小数点)」です。

従来のAI計算はFP16やFP32といった高精度形式が主流でしたが、最新のAIでは**精度を少し落とす代わりに処理速度を大幅に向上させる“低ビット化”**が進んでいます。FP4はその最前線にある技術で、

-

計算量を大幅削減

-

メモリ使用量を圧縮

-

推論速度を高速化

といったメリットがあります。

つまりDGX Sparkは、単純な性能ではなく

👉 “AIに最適化された効率重視の超高速計算”を実現しているマシンです。

2:他GPU(H100 / RTX5090想定)との性能比較

AI性能を語る上で欠かせないのが他GPUとの比較です。DGX Sparkは単体GPUではなく、CPUとGPUが一体化した設計のため、実効性能で大きな差を生みます。

比較のポイントは以下です。

-

H100(データセンター向け)

→ 学習性能は圧倒的だが高コスト・大型環境前提 -

RTX5090(想定・コンシューマー)

→ 汎用性能は高いがVRAM制限あり -

DGX Spark

→ AI推論・ローカル運用に最適化

特に重要なのは、DGX Sparkは128GB統一メモリ+FP4最適化により、実際に扱えるモデルサイズが圧倒的に大きい点です。

👉 ポイント:

理論性能ではなく、

「どれだけ大きなAIを動かせるか」で勝負が決まる。

3:ローカルAI環境としての優位性

DGX Sparkの最大の価値は、この1ペタフロップ性能をクラウドではなくローカルで使えることです。

従来は、

-

大規模モデル → クラウド必須

-

高速推論 → 高額GPU環境

という制約がありましたが、DGX Sparkはそれを覆します。

ローカル環境のメリット:

-

レイテンシ(遅延)が極めて低い

-

クラウド課金が不要

-

データを外部に出さずに処理可能

-

常時稼働でもコスト一定

👉 結論:

DGX Sparkは

“データセンター級AI性能を個人・企業の手元に持ち込む存在”です。

128GB統一メモリの強みと実用性

1:LPDDR5x統一メモリのメリット

DGX Sparkは128GBのLPDDR5xメモリを搭載し、CPUとGPUが同じメモリ空間を共有する「統一メモリ構造」を採用しています。

従来の構成では、

-

CPUメモリ(RAM)

-

GPUメモリ(VRAM)

が分かれており、データの移動に時間がかかるという問題がありました。

しかし統一メモリでは、

-

データコピー不要

-

転送遅延ゼロに近い

-

メモリ効率最大化

が実現されます。

👉 ポイント:

AI処理のボトルネックである“データ転送”を根本から解消。

2:GPUメモリ不足問題の解消

AI開発で最も多い壁が「VRAM不足」です。一般的なGPUでは24GB〜48GB程度が限界で、それ以上のモデルは分割や圧縮が必要でした。

DGX Sparkでは128GBがそのまま使えるため、

-

モデルを分割せずに読み込める

-

大規模LLMをそのまま扱える

-

推論時のパフォーマンス低下が起きにくい

といった大きなメリットがあります。

👉 ポイント:

「動かない」が「普通に動く」に変わるのがDGX Spark。

3:大規模AIモデルに適した理由

大規模AIモデルは、

-

巨大なパラメータ

-

高速なメモリアクセス

-

安定した帯域

を必要とします。

DGX Sparkはこれらをすべて満たしており、特に統一メモリ構造により、

👉 “大規模モデルをそのまま扱える設計”になっています。

結果として、

-

モデル読み込み時間短縮

-

推論の安定化

-

開発効率の向上

といった実用面でのメリットが大きくなります。

最大2000億パラメータ対応の意味

1:LLMのパラメータとは何か

AIモデルにおける「パラメータ」とは、簡単に言えば知識量や表現力の大きさを示す指標です。

-

数十億(B) → 軽量・高速

-

数百億 → 高精度

-

数千億 → 人間レベルに近い応答

DGX Sparkが対応する「最大2000億パラメータ」は、本格的な大規模AIの領域に入る規模です。

👉 ポイント:

パラメータ数=AIの“頭の良さ”の目安。

2:ChatGPT級モデルとの比較

ChatGPTなどのモデルは数百億〜数千億パラメータ規模とされており、通常はデータセンターでしか扱えません。

DGX Sparkでは、

-

軽量化モデル

-

量子化モデル(FP4など)

-

分割処理

を組み合わせることで、ChatGPTクラスに近い性能をローカルで再現可能になります。

これは従来のPCでは不可能だった領域です。

👉 ポイント:

“クラウド専用だったAI”が手元に来る時代。

3:ローカルで動かせるAIの限界と可能性

もちろん、完全な超巨大モデルをそのまま動かすには限界があります。しかしDGX Sparkは、その境界を大きく押し広げています。

現実的に可能な領域:

-

100B〜200BクラスのLLM運用

-

高速推論+微調整

-

専門特化モデルの構築

さらに2台接続による拡張で、より大規模なモデルにも対応可能です。

👉 結論:

DGX Sparkは

“ローカルAIの限界を一段引き上げるマシン”です。

2台接続で4050億パラメータ対応の拡張性

1:Connect-Xネットワーキングの仕組み|単体を超える“AIスケール”

DGX Sparkは単体でも高性能ですが、真価はNVIDIA Connect-Xによる高速ネットワーキングで発揮されます。これは一般的なLAN接続とは異なり、低遅延・高帯域でノード同士を直結し、1つの大きな計算資源として扱える仕組みです。

ポイントは以下の通りです。

-

高速通信によりモデル分散が可能

-

ノード間でデータを効率共有

-

推論・学習の負荷を分散

これにより、単体では難しい規模のモデルでも、複数台を束ねて処理できる“ミニクラスタ”を構築できます。

👉 ポイント:

「1台で限界」ではなく、“つなげば伸びる”設計。

2:スケールアウト設計のメリット|必要な分だけ性能を増やす

DGX Sparkは“スケールアップ(1台を強くする)”ではなく、スケールアウト(台数を増やす)前提の設計です。これにより、用途や予算に応じて段階的に性能を拡張できます。

メリットは非常に大きく、

-

初期は1台でスタート可能

-

負荷増加に応じて追加導入

-

システム停止なしで拡張可能

-

コストを段階的に分散

特に企業導入では、いきなり大規模投資をせずにスモールスタートできる点が評価されます。

👉 ポイント:

DGX Sparkは“買い切りの完成品”ではなく、

“成長できるAI基盤”です。

3:小規模データセンター化の可能性|ローカルでここまでできる

2台接続で最大4050億パラメータ級のモデルに対応できるということは、もはや単なるデスクトップではありません。

実現できること:

-

社内専用LLMの運用

-

AI推論サーバーとして常時稼働

-

複数ユーザー同時利用

-

部門単位のAI基盤構築

つまりDGX Sparkは、数台構成にすることで

👉 “小規模データセンター”として機能するポテンシャルを持っています。

これにより、クラウドに依存せず、自社内でAIインフラを完結させることが可能になります。

👉 結論:

DGX Sparkは“単体で使う機械”ではなく、

“つなげて育てるAIインフラ”です。

4TB NVMe SSDの実用性とAI用途

1:データセット保存容量としての評価|AI時代の標準はTB単位

AI開発では、モデル本体だけでなく大量のデータセットを扱います。そのためストレージ容量は非常に重要です。

DGX Sparkは4TBのNVMe SSDを標準搭載しており、

-

複数のLLMモデル保存

-

学習用データセット管理

-

バージョン違いのモデル保管

といった用途を余裕を持ってカバーできます。

👉 ポイント:

AI環境では「数百GB」では足りない。

TB単位が“普通”になる時代です。

2:高速ストレージの重要性|AIは“読み込み速度”で差が出る

AI処理では、計算性能だけでなくストレージ速度がパフォーマンスを左右します。

NVMe SSDの強み:

-

超高速データ読み込み

-

モデルロード時間の短縮

-

大規模データの即時アクセス

特にLLMでは、起動時に巨大なモデルを読み込むため、ストレージ速度が遅いと数十秒〜数分のロスが発生します。

DGX Sparkは高速NVMeにより、

👉“待たないAI環境”を実現しています。

3:学習・推論時のI/Oボトルネック対策

AI開発で見落とされがちなのがI/O(入出力)のボトルネックです。

典型的な問題:

-

データ読み込み待ちでGPUが遊ぶ

-

推論時にストレージが追いつかない

-

大規模データで処理が詰まる

DGX Sparkでは、

-

高速NVMe

-

統一メモリ構造

-

高帯域データ処理

の組み合わせにより、これらの問題を最小化しています。

👉 ポイント:

AI性能はGPUだけで決まらない。

“ストレージ込みで性能が完成する”。

プリインストールAIソフトウェアの強み

1:NVIDIA DGX OSとは|AI専用に最適化された環境

DGX Sparkには、AI処理に特化したNVIDIA DGX OSがプリインストールされています。これは一般的なOSとは異なり、最初からAI開発に必要な環境が整っているのが特徴です。

主な特徴:

-

AIワークロードに最適化

-

GPU・メモリ管理が効率的

-

セキュリティと安定性を重視

これにより、OSレベルからAI処理が最適化され、無駄のないパフォーマンスを引き出せます。

2:CUDA / TensorRT / AIスタックの利便性

通常のPCでAI環境を構築する場合、

-

CUDAのバージョン調整

-

ドライバ依存問題

-

ライブラリ競合

など、多くのトラブルが発生します。

DGX Sparkでは、

-

CUDA

-

TensorRT

-

各種AIフレームワーク

が最適な状態で統合されており、すぐに開発・実行が可能です。

👉 ポイント:

「環境構築に数日」だった作業が、

“即日スタート”に変わる。

3:環境構築不要のメリット|開発スピードが段違い

AI開発において、最も時間を奪うのが環境構築です。しかしDGX Sparkではその工程がほぼ不要になります。

得られるメリット:

-

セットアップ時間ゼロに近い

-

トラブルシューティング削減

-

チームで同一環境を共有可能

-

再現性の高い開発

結果として、

👉 “すぐ試せる → すぐ改善できる → 開発が加速する”

という好循環が生まれます。

DGX Sparkの用途別おすすめ活用法

1:AI開発(LLM・生成AI)|“ローカルで完結する最強環境”

DGX Sparkの本命用途は、やはりLLMや生成AIの開発です。128GB統一メモリと1ペタフロップ級性能により、これまでクラウド前提だった開発がローカルで完結します。

具体的には、

-

LLMの推論・微調整(LoRAなど)

-

Stable Diffusionなどの画像生成

-

動画生成・音声生成AIの検証

などが快適に動作します。

👉 ポイント:

“試す→改善→再実行”のループが高速化し、開発スピードが圧倒的に向上。

2:データサイエンス|大規模データ処理を高速化

DGX Sparkは、機械学習やデータ分析にも強力です。

-

大規模データの前処理

-

モデル学習・評価

-

データ可視化・分析

統一メモリによりデータ転送の無駄がなく、データ処理の効率が大幅に向上します。

👉 ポイント:

GPUを活かした“高速データ処理環境”としても優秀。

3:企業のPoC環境|“試せるAI”を社内に

企業にとってDGX Sparkは、PoC(概念実証)に最適な環境です。

-

新しいAIツールの検証

-

社内データを使った実験

-

クラウド依存なしのAI評価

これにより、導入前にしっかり検証できる体制が整います。

👉 ポイント:

「とりあえず試す」が低コストで可能になる。

4:エッジAI・研究用途|専門領域でも活躍

DGX Sparkは研究用途やエッジAI開発にも適しています。

-

ロボットAI開発

-

IoT連携AI

-

学術研究

👉 結論:

DGX Sparkは

“AIを扱うほぼすべての用途に対応する万能基盤”です。

一般PC・ゲーミングPCとの違い

1:RTX搭載PCとの違い|設計思想が別物

RTX搭載PCは“汎用高性能マシン”ですが、DGX SparkはAI専用機です。

違いは明確で、

-

RTX PC → ゲーム・動画・AIすべて対応

-

DGX Spark → AI処理に特化

特に統一メモリ構造はRTX PCにはない大きな強みです。

2:ゲーム用途に向かない理由

DGX SparkはGPU性能が高いものの、ゲーム用途には最適化されていません。

理由:

-

ゲーム向けドライバ最適化がない

-

ARM環境で対応ソフトが限定的

-

フレームレート重視設計ではない

👉 ポイント:

“高性能=ゲーム向き”ではない。

3:AI専用機としての立ち位置

DGX Sparkは、

👉 「AIを使うための専用ツール」

であり、PCの延長ではなく新しいカテゴリのマシンです。

DGX Sparkのメリット・デメリット

メリット

-

圧倒的AI性能

-

コンパクト設計

-

クラウド不要のローカルAI環境

👉 “時間・コスト・自由度”すべてを改善

デメリット

-

価格の高さ(推定)

-

一般用途にはオーバースペック

-

ARM環境の互換性問題

👉 向き・不向きがはっきり分かれる

DGX Sparkはどんな人におすすめか

1:AI開発者・研究者

-

LLMや生成AIを扱う人

-

高速な検証環境が必要な人

👉 最も恩恵を受ける層

2:スタートアップ企業

-

AIサービス開発

-

コスト削減+スピード重視

👉 “小さく始めて大きく伸ばす”に最適

3:ローカルLLMを扱うユーザー

-

ChatGPT代替を作りたい

-

自前AIを運用したい

👉 クラウド依存から脱却したい人

導入前に知っておくべき注意点

1:消費電力・発熱

-

長時間稼働で発熱あり

-

冷却環境の確保が必要

2:ソフトウェア対応(ARM)

-

一部ツールが非対応

-

事前検証が重要

3:ネットワーク環境の重要性

-

複数台運用で必須

-

高速ネットワーク推奨

👉 ポイント:

“買って終わり”ではなく環境設計が重要

DGX Sparkと他AIマシン比較(2026最新版)

1:DGX Stationとの違い

-

DGX Station → 大規模・高価格

-

DGX Spark → 小型・導入しやすい

2:クラウド(AWS/GCP)との比較

-

クラウド → 柔軟・高コスト

-

DGX Spark → 固定費・長期有利

3:ローカルAI vs クラウドAI

-

ローカル → 高速・低コスト・セキュア

-

クラウド → スケーラブル・手軽

👉 結論:

用途によって使い分けが最適

価格・発売日・入手方法まとめ

1:価格帯予想

-

数百万円クラスの可能性

-

法人向け価格帯

2:販売チャネル

-

NVIDIA公式

-

パートナー企業経由

3:法人向け販売の可能性

-

BtoB中心

-

個人購入は限定的の可能性

👉 ポイント:

“誰でも買える製品ではない可能性”

今後のAI開発はDGX Sparkでどう変わるか

1:ローカルAI時代の到来

クラウド中心から、

👉 “手元でAIを動かす時代”へシフト

2:開発スピードの変化

-

待ち時間ゼロ

-

即検証・即改善

👉 圧倒的なスピード差

3:個人でも扱えるAIインフラ

これまで企業専用だったAI環境が、

👉 “個人レベルでも扱える時代”に突入

まとめ|DGX Sparkは“AI開発の革命機”

1:小型でデータセンター級性能|“机の上にあるAIインフラ”

DGX Sparkの最大のインパクトは、これまでデータセンターでしか扱えなかったレベルのAI性能を、デスクトップサイズに凝縮した点にあります。1ペタフロップ級のAI処理能力、128GB統一メモリ、そして大規模モデル対応というスペックは、従来のPCとは完全に別次元です。

これにより、これまで必要だった

-

高額なクラウド契約

-

大規模サーバー環境

-

専用インフラ構築

といったハードルを一気に取り払います。

👉 ポイント:

DGX Sparkは単なるPCではなく、

“机の上に置けるAIデータセンター”です。

2:ローカルAIの最前線マシン|クラウド依存からの脱却

AI開発はこれまでクラウド前提でしたが、DGX Sparkの登場により状況は大きく変わります。ローカルで大規模AIを扱えることで、

-

レイテンシの削減

-

コストの最適化

-

データの完全管理

が可能になります。

さらに、

-

試行錯誤を高速で回せる

-

API制限に縛られない

-

自由なAI設計が可能

といった点で、開発の自由度が飛躍的に向上します。

👉 ポイント:

DGX Sparkは

“クラウドを補完する存在”ではなく、“置き換える選択肢”。

3:AI開発者にとって最強クラスの選択肢

DGX Sparkは万人向けではありません。しかし、AIを本格的に扱う人にとっては、

-

開発スピード

-

コスト効率

-

扱えるモデル規模

すべての面でトップクラスの選択肢になります。

特に、

-

LLM開発者

-

スタートアップ企業

-

ローカルAI志向のエンジニア

にとっては、“環境そのものが競争力”になる時代において、非常に強力な武器になります。

最終結論|DGX Sparkは“AIを持つ時代”の象徴

DGX Sparkは単なるハードウェアではなく、

👉 「AIを使う」から「AIを持つ」へ

という時代の転換点を象徴する存在です。

そして今後、AI開発の主戦場は

クラウド一極からローカルとのハイブリッドへと移行していきます。

その中心にあるのがDGX Sparkです。

👉 結論:

DGX Sparkは、

“AI開発の常識を塗り替える革命機”であり、

これからのAI時代を牽引する基盤となるでしょう。